Overstelpen computers ons straks met onzin?

Waarschijnlijk heeft er nog nooit een website in de eerste dagen van zijn bestaan zó snel zó veel gebruikers gekregen als ChatGPT. Daarop kun je sinds eind november automatisch – door het formuleren van een opdrachtprompt – teksten laten schrijven over willekeurig welk onderwerp; naar verluidt hadden zich binnen vijf dagen al een miljoen gebruikers ingeschreven voor de dienst. Ter vergelijking: Netflix deed drieënhalve maand over dat eerste miljoen. De groei heeft sindsdien alleen maar doorgezet: hoewel OpenAI, het bedrijf achter ChatGPT, geen gegevens prijsgeeft, hebben waarschijnlijk honderden miljoenen mensen op deze manier allerlei tekstjes laten schrijven.

De resultaten zijn dan ook verbazingwekkend. Wie de afgelopen maanden de media heeft gevolgd, kon er al veel staaltjes van zien. Het systeem schrijft net zo gemakkelijk een computerprogramma om te bepalen of twee woorden anagrammen zijn als een glasheldere uitleg over het verschil tussen de romaanse en de gotische kerkbouw. En tussendoor nog een gedicht over de smaak van sushi in de stijl van William Shakespeare, een persbericht over de ontdekking van het perpetuum mobile, en een gloedvol betoog in het Fries tegen de Elfstedentocht (“in ûnbehannelbere belêsting foar de lokale mienskip”).

Schattingen

Dat een apparaat dit allemaal kan, zo snel en vooralsnog ook nog gratis, is nooit eerder vertoond. Althans, de afgelopen jaren kwamen er uit de wetenschap en de computerindustrie al wel berichten over de snelheid waarmee computers leerden met taal om te gaan, maar nu kon iedereen het ineens zelf proberen.

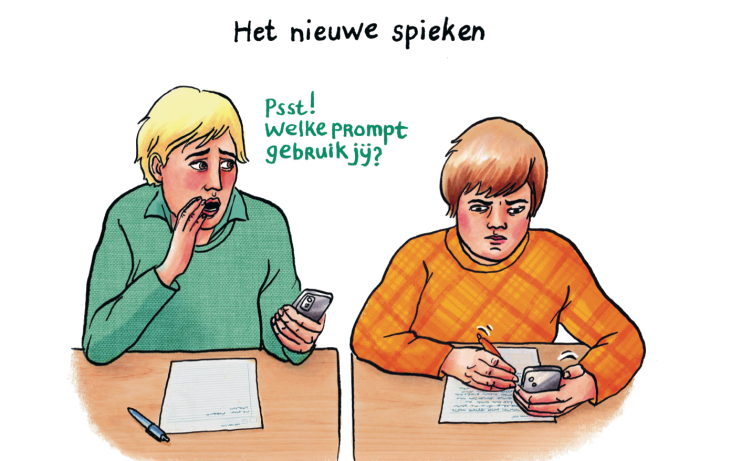

Er waren vrijwel onmiddellijk ook ongewenste toepassingen. Midden januari verschenen er alarmerende berichten over scholieren die de chatbot hun huiswerk lieten doen. Waarom zou je zelf een opstel schrijven als je het in een mum van tijd door de computer kunt laten doen? De servers van OpenAI raakten dan ook geregeld overbelast. Volgens sommige schattingen kostte het het bedrijf een miljoen euro per dag om aan alle schrijfopdrachten van over de hele wereld te voldoen.

Match

De innovatieve techniek achter ChatGPT is nog maar een paar jaar oud. In 2017 schreven enkele onderzoekers van Google een artikel dat ‘Attention Is All You Need’ heette, ‘Aandacht volstaat’. Zij richtten zich in eerste instantie op vertaalcomputers, zoals die van Google Translate. Eerdere vertaalcomputers gebruikten een in wezen heel eenvoudige techniek: ze vertaalden woord voor woord, en om dubbelzinnigheden op te lossen letten ze daarbij hooguit op wat er onmiddellijk voor en achter het te vertalen woord stond. Het Engelse match vertaal je als ‘overeenkomen’ als er to voor staat (to match), maar als ‘wedstrijd’ of ‘lucifer’ als er het lidwoord the voor staat.

De ambiguïteit tussen de laatste twee betekenissen is lastiger op te lossen. Je moet daarvoor vaak in een wat bredere context kijken, soms meerdere woorden verderop. ‘The players are enjoying the match’ roept meestal de eerste betekenis op: ‘De spelers genieten van de wedstrijd.’ ‘The heavy smoker was desperately looking for a match’ de andere: ‘De zware roker zocht wanhopig naar een lucifer.’

In dit geval staan de woorden die de dubbelzinnigheid oplossen nog in dezelfde zin, maar in sommige gevallen kunnen ze ook heel ergens anders in de tekst staan. Dat maakte de oude oplossing onwerkbaar, want ook de krachtigste computers kunnen niet naar hele teksten tegelijk kijken. Daarom is de ‘aandacht’ uit de titel van het stuk van de Google-onderzoekers zo belangrijk: je moest de computer leren de aandacht alleen te richten op bepaalde woorden in de context, zoals in dit geval op spelers of roker. Of er in een vorige zin voor zo’n woord de of het staat, maakt daarbij meestal geen verschil.

Moreel kompas

Op de uitvinding van deze automatische ‘aandacht’ werden al snel ook andere dan vertaalcomputers gebouwd, zoals dus chatbots die met de gebruiker in gesprek kunnen gaan over willekeurig welk onderwerp. Er zijn inmiddels zogeheten ‘taalmodellen’ gemaakt op basis van deze techniek die aan de hand van miljarden teksten hebben geleerd waar de aandacht naartoe moet en die zo zelf hebben leren schrijven. GPT-3 bijvoorbeeld, het taalmodel waarop ChatGPT gebaseerd is, heeft ongeveer 45 terabyte aan tekst gelezen, een overstelpende hoeveelheid; daar zit bijvoorbeeld waarschijnlijk vrijwel het hele openbaar toegankelijke internet bij. Naar verwachting verschijnt dit jaar een nog veel krachtiger opvolger: GPT-4.

De makers van ChatGPT hebben trouwens nog wel een ‘schil’ om GPT3 gelegd, die bijvoorbeeld probeert te voorkomen dat het systeem racistische of seksistische taal uitslaat. Dat is vaak een probleem van taalmodellen die getraind worden op internetmateriaal: ze komen dat soort praatjes vaak tegen en zonder eigen moreel kompas herhalen ze die dan.

Stem

Er zijn ook verder nog genoeg redenen om de huidige ontwikkelingen met zorg te bezien. Taalmodellen zijn duur en slurpen energie – volgens sommige schattingen evenveel als een middelgrote stad. Om de resultaten te toetsen en de ‘schil’ te maken is bovendien gebruikgemaakt van onderbetaalde krachten in derdewereldlanden. Het is de vraag of de lol van automatische teksten daartegen opweegt. Bovendien moeten die kosten natuurlijk op de een of andere manier worden terugverdiend. OpenAI heeft al aangekondigd dat het in de voortgebrachte teksten een ‘watermerk’ wil verbergen: een statistisch patroon dat de mens niet opvalt, maar dat OpenAI zelf wel herkent. Leraren die met de handen in het haar zitten over de werkstukken van hun scholieren, kunnen dan – maar dan wel tegen betaling – opsporen of ChatGPT gebruikt is.

Een ander bezwaar is dat wij op deze manier mogelijk het schrijven verleren. Er is misschien geen betere manier om je gedachten te ordenen dan door te schrijven, dus wat als dat niet meer hoeft? Hoeveel er verloren gaat aan menselijke denkkracht door het inzetten van de computer valt niet te voorzien.

Tot slot wijzen sommige critici op de mogelijke toename van de hoeveelheid onzin, spam en fakenews op het internet. Als menselijke trollen, met hun beperkte menselijke krachten, nu al zoveel schade kunnen toebrengen aan allerlei discussies, wat betekent het dan voor de democratie als er straks computers zijn die permanent miljoenen onzinteksten uitbraken die allemaal op internet kunnen worden geplaatst? ChatGPT is een leuk speeltje, maar helpen alle mensen die er nu mee spelen er niet aan mee dat we straks overstelpt raken met onzin? En moeten we ook hier weer met dure software gewatermerkte teksten wegfilteren om nog iets te kunnen vinden van een menselijke stem?

Alsjeblieft!

Dit artikel uit het maart/aprilnummer (2023) van Onze Taal kreeg je cadeau.